Apple konnte es kaum erwarten. Auch wenn seine Eröffnungs-Keynote zur WWDC für Anfang Juni geplant ist, schreitet das Gebiet der KI jeden Tag voran, was wahrscheinlich der Grund ist, warum er keine Zeit mehr verschwenden wollte. In Form einer Pressemitteilung erläuterte er, was seine künstliche Intelligenz in iOS 17 leisten kann und fügte weitere Funktionen hinzu, die sich um Barrierefreiheit drehen. Davon gibt es einiges, die Funktionen sind interessant, allerdings gibt es ein gewisses Fragezeichen hinsichtlich der Massentauglichkeit.

Es könnte sein interessiert dich

Die Nachrichtenankündigung wurde auch durch den am Donnerstag stattfindenden Welttag der Barrierefreiheit unterstützt, da sich die neu eingeführten Funktionen um die Barrierefreiheit von iPhones von A bis Z drehen. Barrierefreiheit ist ein großer Funktionsblock auf dem iPhone, der dabei helfen soll, es flächendeckend zu steuern Verschiedene Formen der Behinderung, obwohl viele davon natürlich jeder nutzen kann, was auch für die Neuigkeiten gilt, die wir in iOS 17 sehen werden. Allerdings basieren nicht alle davon, wie zum Beispiel Assistive Access, zu 100 % auf KI.

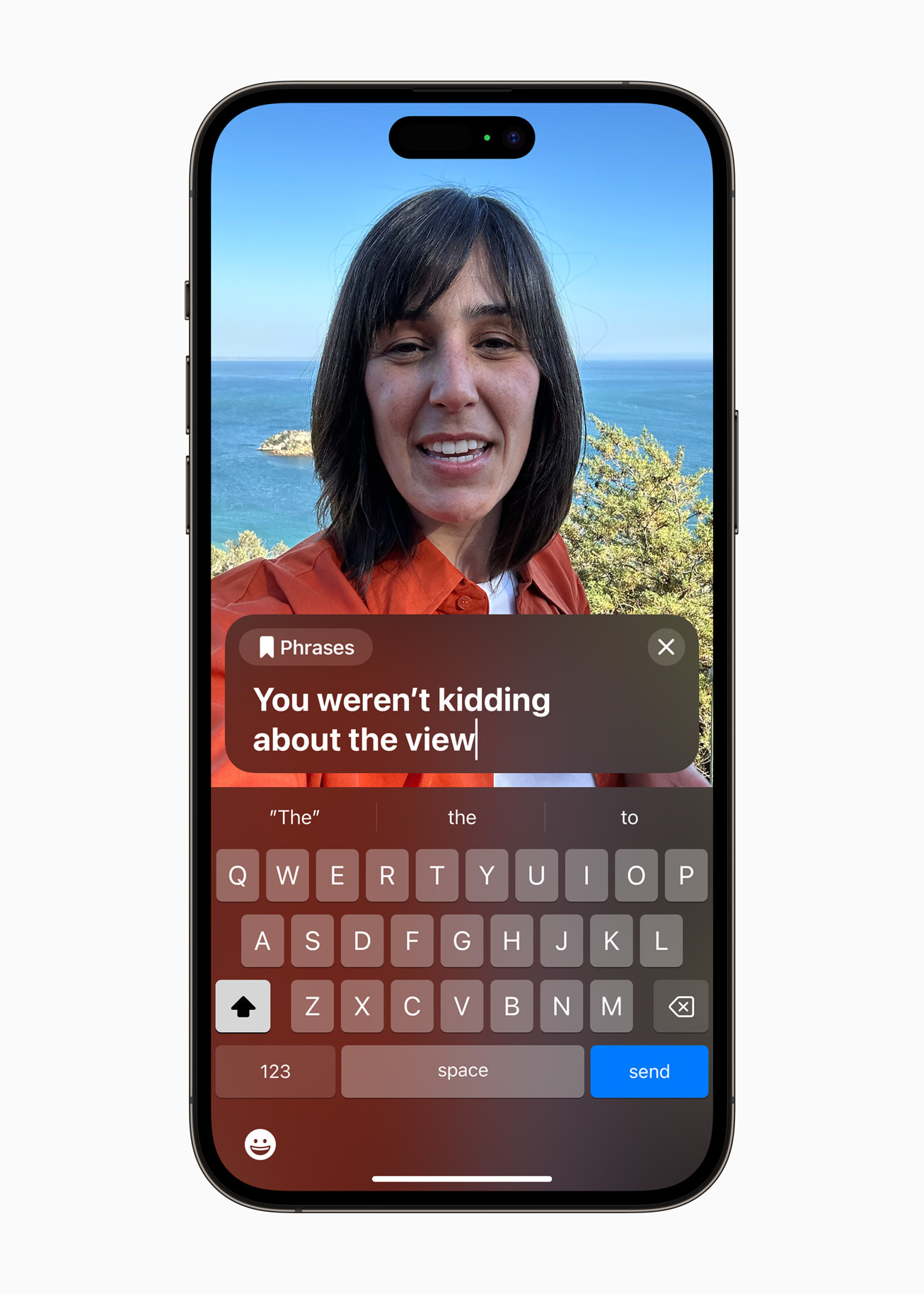

Live-Rede

Was Sie auf das iPhone-Display schreiben, wird auf der anderen Seite vorgelesen. Es sollte lokal funktionieren, obwohl es auch bei einem Telefonanruf funktionieren sollte. Die Funktion kann in Echtzeit arbeiten, bietet aber gleichzeitig voreingestellte Phrasen, um die Kommunikation nicht nur am einfachsten, sondern auch am schnellsten zu gestalten, wenn häufig verwendete Verbindungen nicht notiert werden müssen. Es stellt sich eine große Frage der Verfügbarkeit, also ob das auch in der tschechischen Sprache funktioniert. Wir hoffen es, aber wir glauben nicht zu sehr daran. Was schließlich auch für andere Nachrichten gilt.

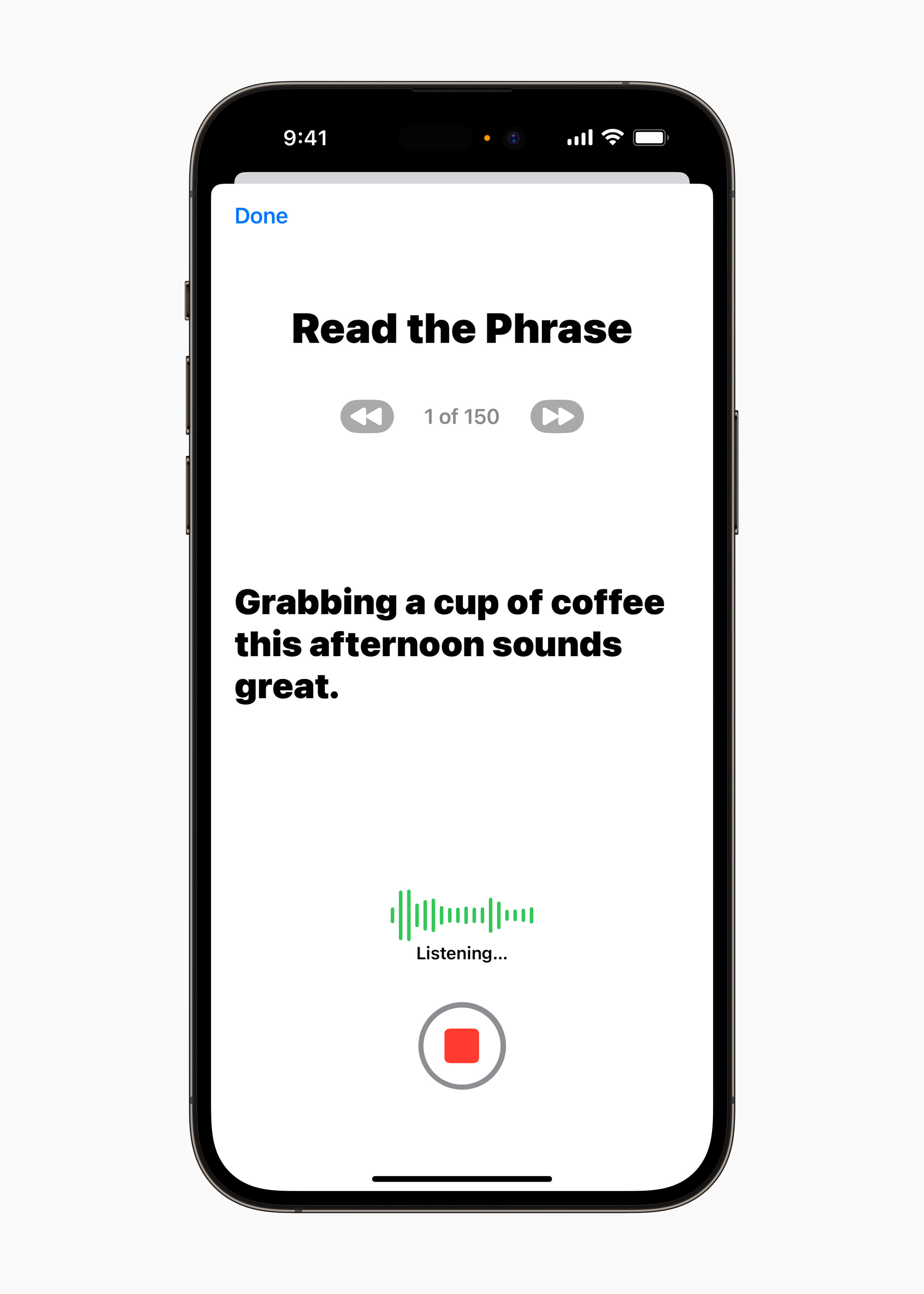

Persönliche Stimme

Anknüpfend an die vorherige Neuerung gibt es auch eine mit Stimme und Sprache verbundene Funktion, für die es allerdings noch keine Parallele gibt. Mit der Personal Voice-Funktion können iPhones eine exakte Kopie Ihrer eigenen Stimme erstellen, die Sie im Fall des vorherigen Punktes verwenden können. Der Text wird nicht von einer einheitlichen Stimme gelesen, sondern von Ihnen. Mit Ausnahme von Telefonanrufen kann dies natürlich auch in iMessage-Audionachrichten usw. verwendet werden. Die gesamte Erstellung Ihrer Stimme wird durch KI und maschinelles Lernen nicht länger als 15 Minuten dauern, in denen Sie den präsentierten Text und andere Texte lesen Aufforderungen. Sollten Sie dann aus irgendeinem Grund Ihre Stimme verlieren, wird diese auf Ihrem iPhone gespeichert und Sie können weiterhin mit ihr sprechen. Es sollte kein Sicherheitsrisiko darstellen, da alles lokal geschieht.

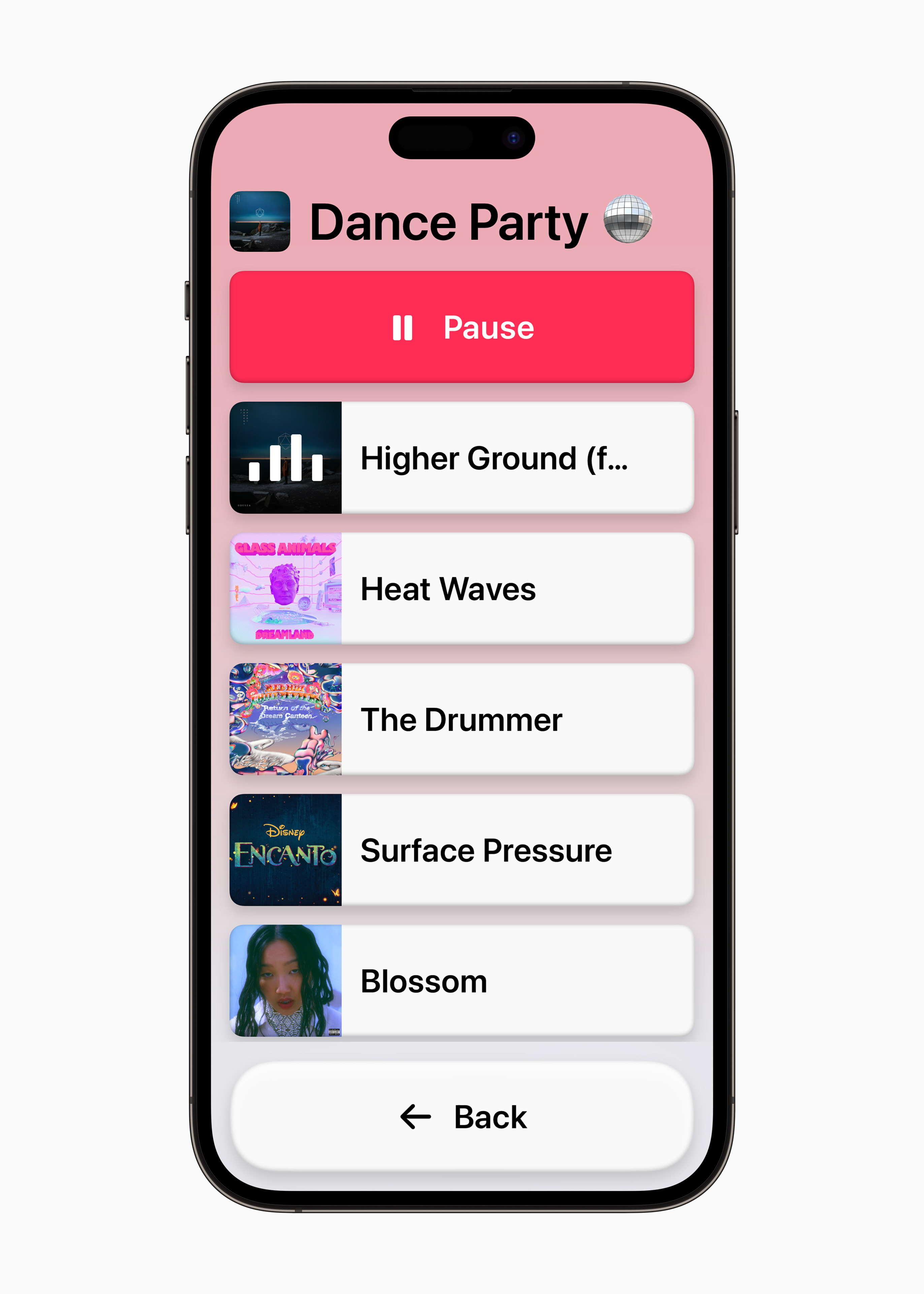

Assistenzansatz

In der Welt der Android-Geräte ist der Seniorenmodus weit verbreitet. Darüber hinaus ist es auch sehr einfach zu bedienen, genau wie das, das die Benutzeroberfläche für die Kleinen anpasst. Im Fall von iPhones wurde über Erstgenanntes schon lange spekuliert, doch nun hat Apple es endlich enthüllt. Durch die Aktivierung wird die Umgebung insgesamt vereinfacht, wenn beispielsweise Anwendungen wie Phone und FaceTime vereinheitlicht werden, die Symbole größer werden und es auch Anpassungen geben wird, dank derer die Benutzeroberfläche genau darauf eingestellt wird die Bedürfnisse des Benutzers (Sie können eine Liste anstelle eines Rasters usw. erstellen).

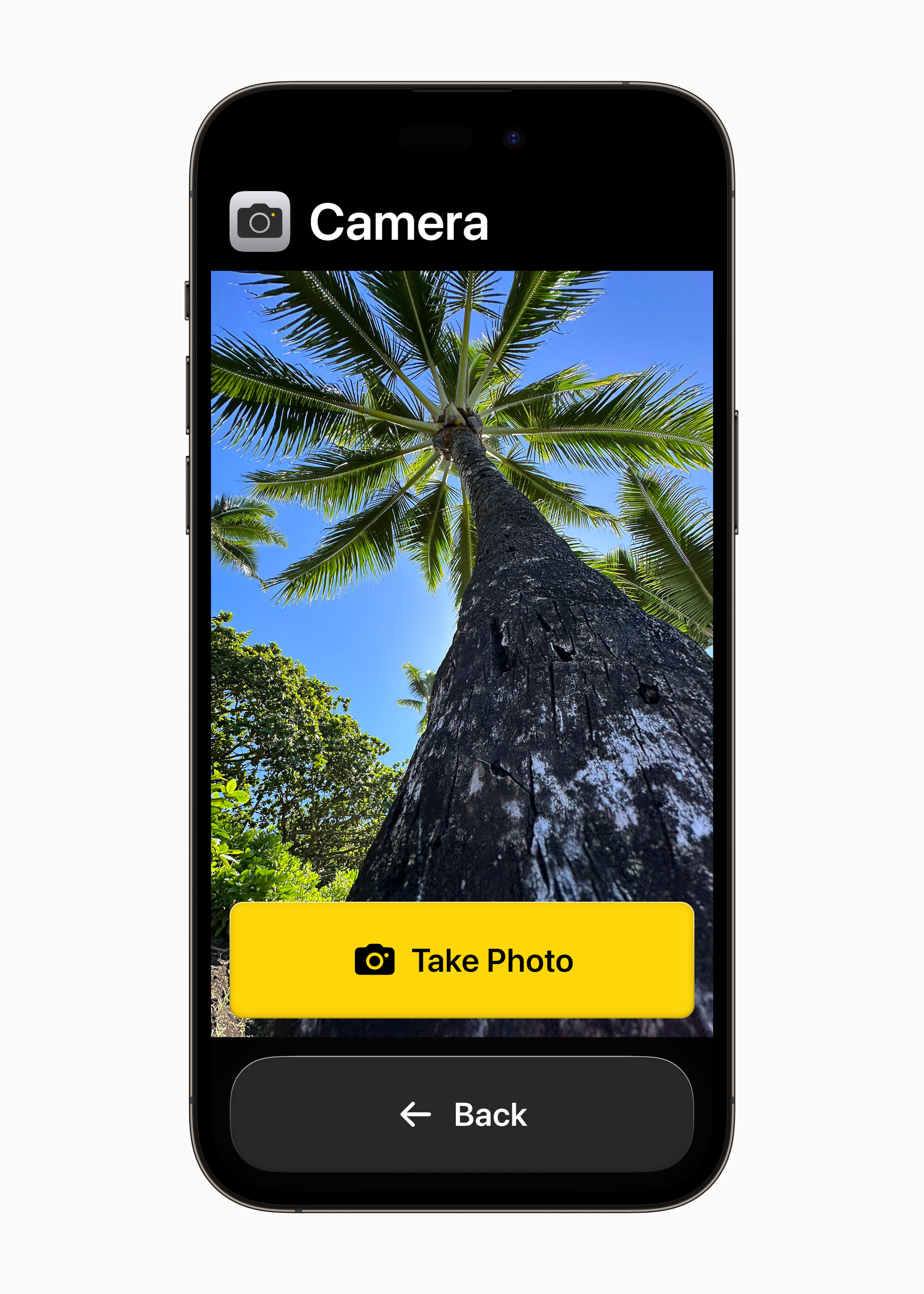

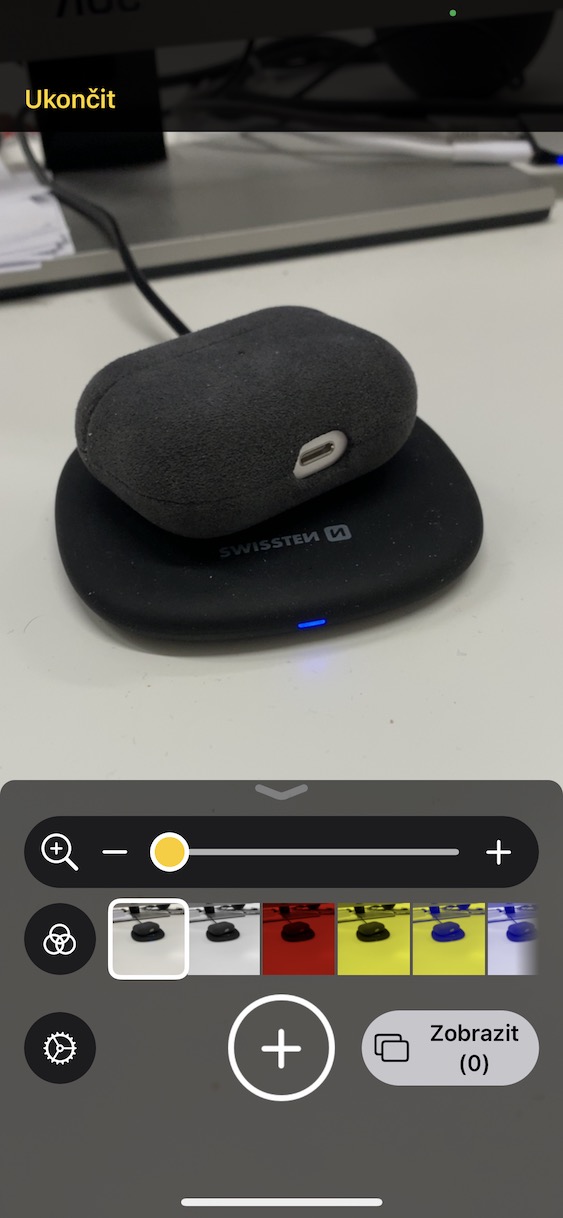

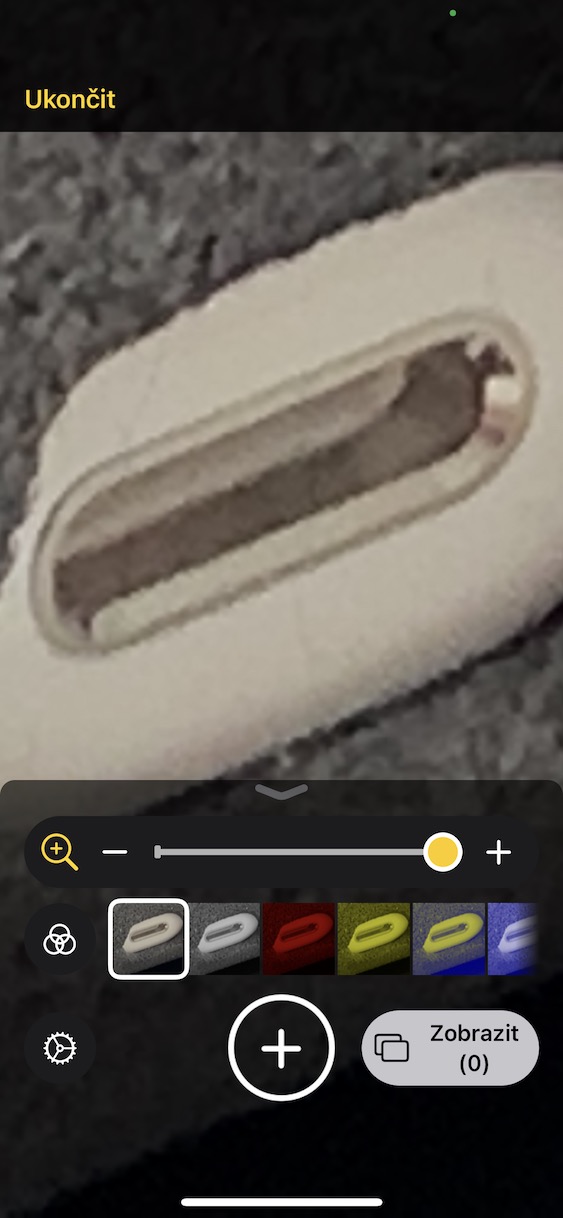

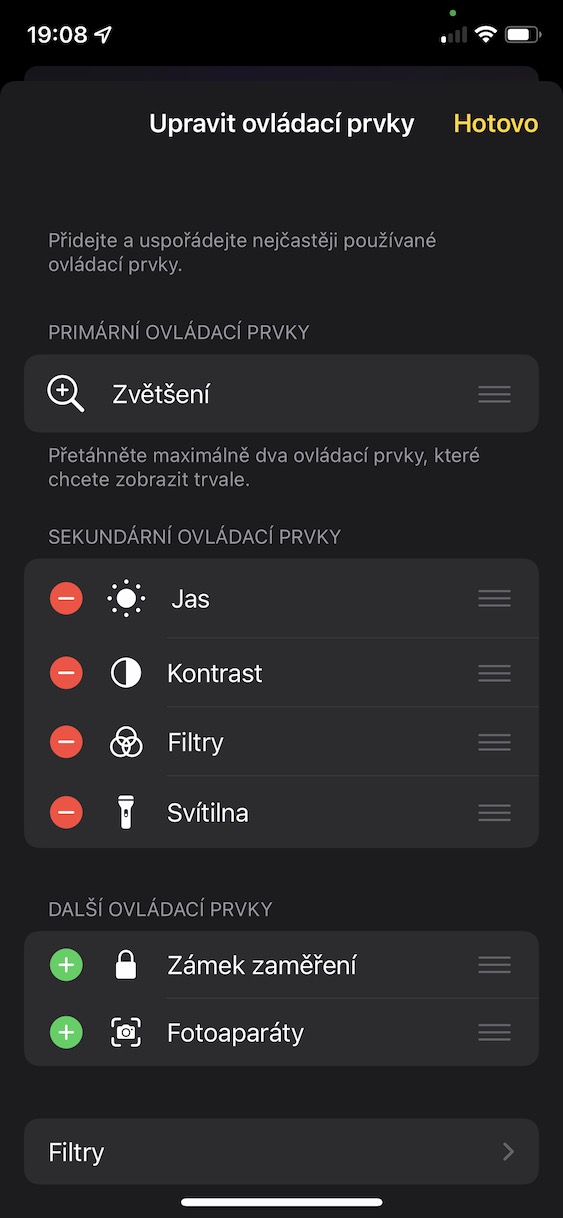

Erkennungsmodus für Lupenfunktionen

Wenn jemand an einer Sehbehinderung leidet, wird Apple versuchen, ihm das Leben zu erleichtern, indem es die Lupenfunktion nutzt, die maschinelles Lernen und KI nutzt, um zu erkennen, worauf der Telefonbenutzer durch den Kamerasucher zeigt. Die Funktion sollte es dann richtig erkennen und dem Benutzer per Stimme mitteilen. Schließlich gibt es im App Store ziemlich viele Anwendungen zu diesem Thema, sie sind sehr beliebt und wirklich funktional, sodass klar ist, woher Apple seine Inspiration hat. Beim direkten Zeigen, also ja, mit dem Finger geht Apple noch einen Schritt weiter. Dies ist beispielsweise bei verschiedenen Tasten an Geräten nützlich, wenn der Benutzer genau weiß, welchen Finger er hat und ob er ihn drücken soll. Dennoch soll die Lupe auch Menschen, Tiere und viele andere Dinge erkennen können, was schließlich auch mit Google Lens möglich ist.

Weitere Neuigkeiten Barrierefreiheit

Eine weitere Reihe von Funktionen wurde veröffentlicht, von denen zwei besonders hervorzuheben sind. Die erste Möglichkeit besteht darin, Bilder mit beweglichen Elementen, typischerweise GIFs, in Nachrichten und Safari anzuhalten. Danach geht es um die Sprechgeschwindigkeit von Siri, die Sie von 0,8 auf die doppelte Geschwindigkeit begrenzen können.

Es könnte sein interessiert dich

Adam Kos

Adam Kos