Künstliche Intelligenz wird von allen genutzt, aber nur wenige verfügen über Tools, die sich direkt darauf beziehen. Google ist hier am weitesten fortgeschritten, obwohl man durchaus sagen könnte, dass Google hier am sichtbarsten ist. Sogar Apple hat KI und zwar fast überall, man muss es nur nicht ständig erwähnen.

Haben Sie den Begriff maschinelles Lernen gehört? Wahrscheinlich, weil es ziemlich oft und in vielen Zusammenhängen verwendet wird. Aber was ist es? Sie haben es erraten, dies ist ein Teilgebiet der künstlichen Intelligenz, das sich mit Algorithmen und Techniken befasst, die es einem System ermöglichen, zu „lernen“. Und erinnern Sie sich, als Apple zum ersten Mal etwas über maschinelles Lernen sagte? Es ist lange her.

Wenn Sie zwei Keynotes zweier Unternehmen vergleichen, die größtenteils das Gleiche präsentieren, werden sie völlig unterschiedlich sein. Google verwendet den Begriff KI als eigenes Mantra, Apple sagt den Begriff „KI“ kein einziges Mal. Er hat es und er hat es überall. Immerhin erwähnt Tim Cook es, als er nach ihr gefragt wird, obwohl er auch zugibt, dass wir nächstes Jahr noch mehr über sie erfahren werden. Das bedeutet aber nicht, dass Apple jetzt schläft.

Es könnte sein interessiert dich

Anderes Etikett, gleiches Problem

Apple integriert KI auf benutzerfreundliche und praktische Weise. Ja, wir haben hier keinen Chatbot, andererseits hilft uns diese Intelligenz bei praktisch allem, was wir tun, wir wissen es nur nicht. Es ist leicht zu kritisieren, aber sie wollen nicht nach Verbindungen suchen. Es spielt keine Rolle, wie man künstliche Intelligenz definiert, entscheidend ist, wie sie wahrgenommen wird. Es ist für viele Unternehmen zu einem universellen Begriff geworden und wird in der breiten Öffentlichkeit etwa so wahrgenommen: „Es ist eine Möglichkeit, Dinge in einen Computer oder ein Mobiltelefon zu stecken und uns das geben zu lassen, was wir verlangen.“

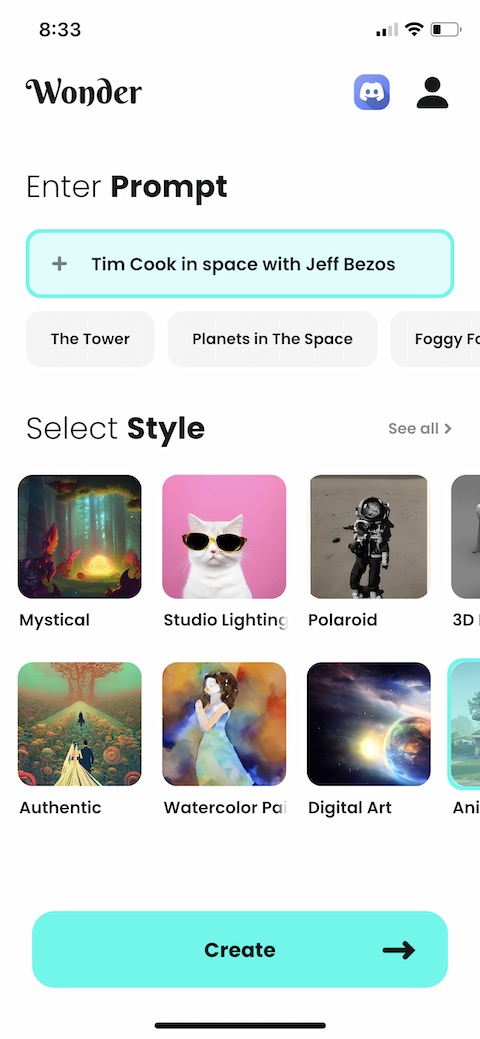

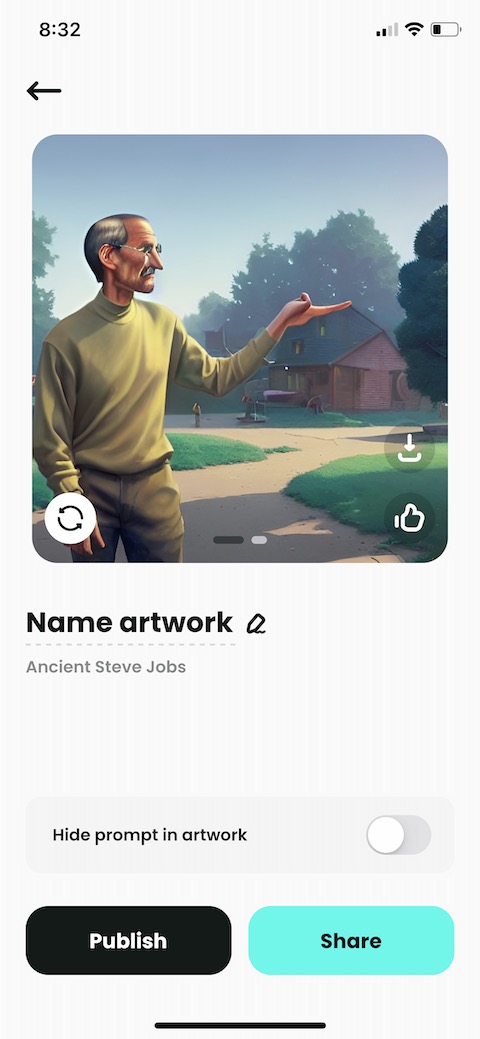

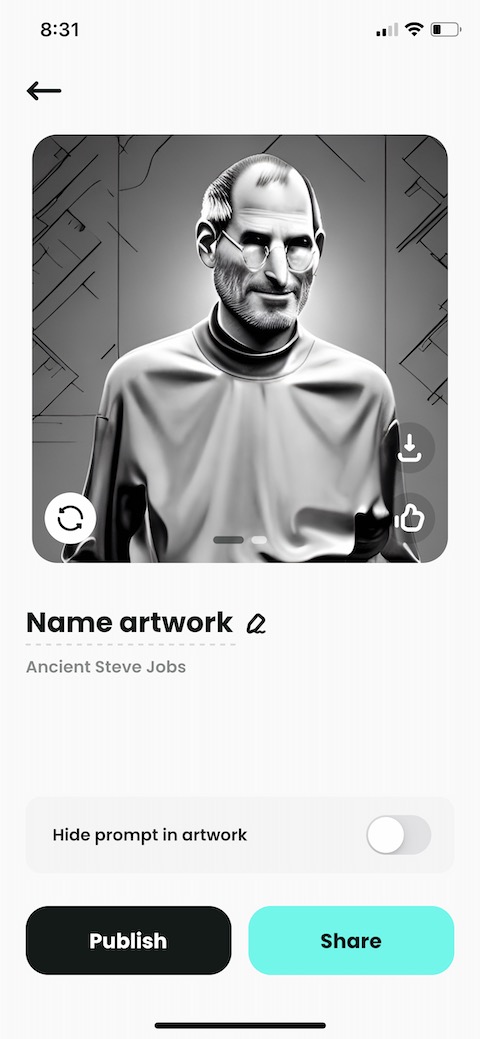

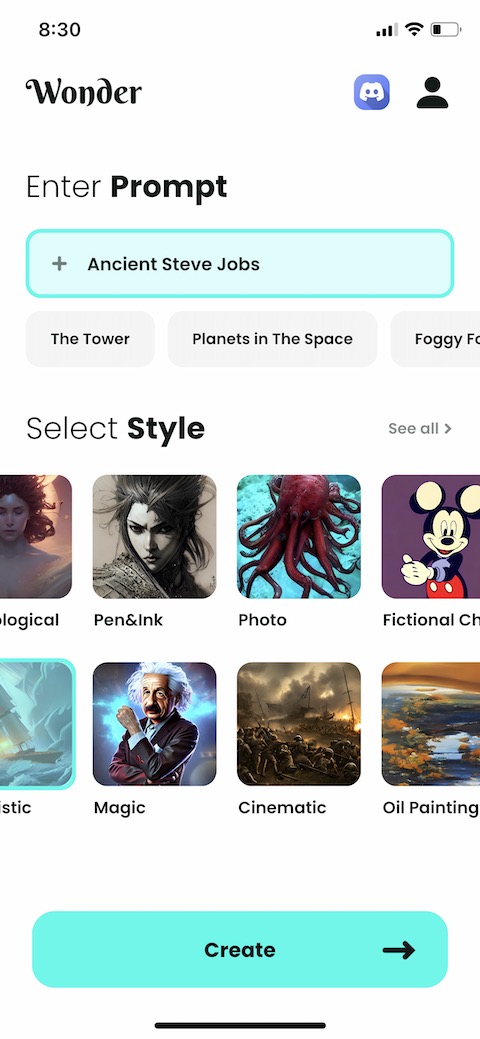

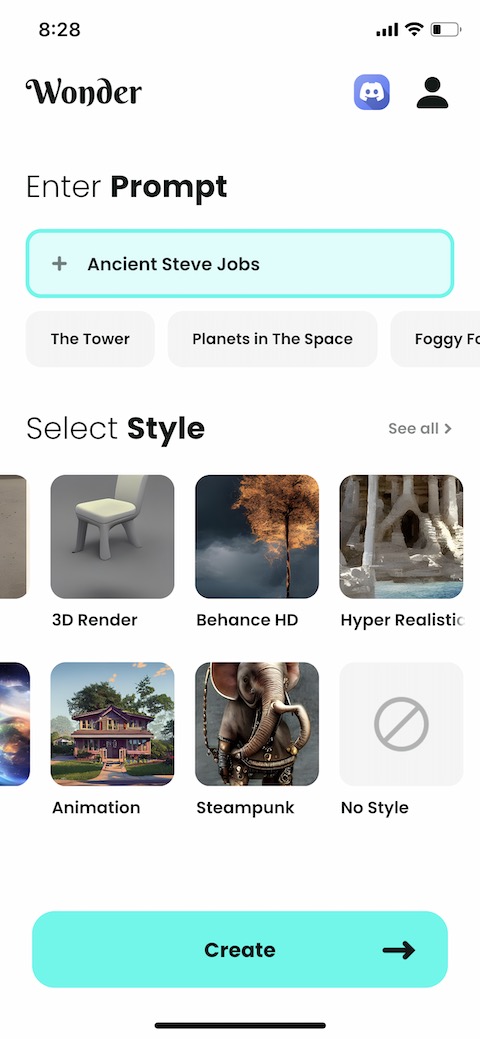

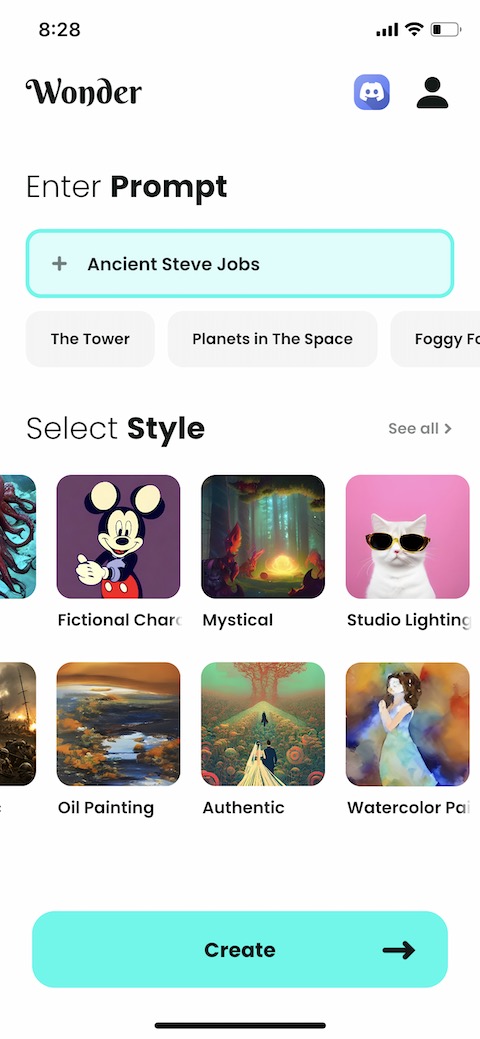

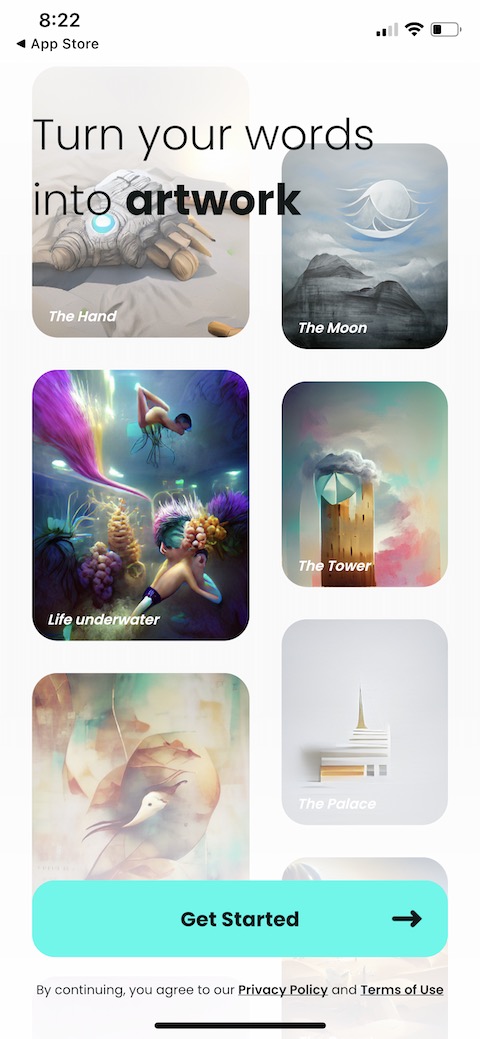

Wir möchten vielleicht Antworten auf Fragen, einen Text erstellen, ein Bild erstellen, ein Video animieren usw. Aber jeder, der schon einmal Apple-Produkte verwendet hat, weiß, dass das so nicht funktioniert. Apple möchte nicht zeigen, wie es hinter den Kulissen funktioniert. Doch jede neue Funktion in iOS 17 setzt auf künstliche Intelligenz. Fotos erkennen dank ihm einen Hund, die Tastatur bietet dank ihm Anpassungen, sogar AirPods nutzen es zur Geräuscherkennung und vielleicht auch NameDrop für AirDrop. Wenn die Vertreter von Apple erwähnen würden, dass jede Funktion eine Art Integration künstlicher Intelligenz beinhaltet, würden sie nichts anderes sagen.

Alle diese Funktionen nutzen das, was Apple gerne „maschinelles Lernen“ nennt, was im Wesentlichen dasselbe ist wie KI. Bei beiden geht es darum, dem Gerät Millionen von Beispielen von Dingen zu „füttern“ und das Gerät die Beziehungen zwischen all diesen Beispielen ermitteln zu lassen. Das Schlaue dabei ist, dass das System das ganz von alleine macht, indem es die Dinge nach und nach ausarbeitet und daraus seine eigenen Regeln ableitet. Er kann diese geladenen Informationen dann in neuen Situationen verwenden, indem er seine eigenen Regeln mit neuen und unbekannten Reizen (Bildern, Texten usw.) vermischt, um dann zu entscheiden, was er damit machen möchte.

Es könnte sein interessiert dich

Es ist praktisch unmöglich, die Funktionen aufzuzählen, die in Apples Geräten und Betriebssystemen irgendwie mit KI funktionieren. Künstliche Intelligenz ist mit ihnen so stark verflochten, dass die Liste bis zur Benennung der letzten Funktion so lang wäre. Dass Apple es mit maschinellem Lernen wirklich ernst meint, zeigt auch die Neural Engine, also ein Chip, der genau für die Verarbeitung ähnlicher Fragestellungen geschaffen wurde. Nachfolgend finden Sie nur einige Beispiele, bei denen KI in Apple-Produkten zum Einsatz kommt und Sie vielleicht gar nicht daran denken.

- Bilderkennung

- Spracherkennung

- Textanalyse

- Spam-Filterung

- EKG-Messung

Adam Kos

Adam Kos

Wenn Apple KI so vehement einsetzt, sollte es sie insbesondere in Schlüsselanwendungen wie dem Übersetzer einsetzen. Es ist traurig, dass X Jahre nach der Einführung praktisch nichts mit dem Übersetzer passiert.