Das mobile Betriebssystem iOS 13 bringt außerdem eine sehr interessante Funktion mit, die es Anwendungen ermöglicht, verschiedene Aufnahmen von verschiedenen Kameras desselben Geräts inklusive Ton aufzunehmen.

Ähnliches funktioniert auf dem Mac seit den Tagen des Betriebssystems OS X Lion. Doch die begrenzte Leistungsfähigkeit mobiler Hardware ließ dies bisher nicht zu. Doch mit der neuesten iPhone- und iPad-Generation fällt auch diese Hürde und iOS 13 kann somit gleichzeitig von mehreren Kameras auf einem Gerät aufzeichnen.

Es könnte sein interessiert dich

Dank der neuen API können Entwickler auswählen, von welcher Kamera die Anwendung welche Eingaben entgegennimmt. Mit anderen Worten: Die Frontkamera kann beispielsweise Videos aufzeichnen, während die Rückkamera Bilder aufnimmt. Das gilt auch für den Ton.

Ein Teil der Präsentation auf der WWDC 2019 war eine Demonstration, wie eine Anwendung mehrere Datensätze verwenden kann. Die Anwendung kann somit den Benutzer aufzeichnen und gleichzeitig den Hintergrund der Szene mit der Rückkamera aufzeichnen.

Gleichzeitige Aufzeichnung mehrerer Kameras nur bei Neugeräten

In der Fotos-Anwendung war es dann möglich, beide Aufnahmen während der Wiedergabe einfach auszutauschen. Darüber hinaus erhalten Entwickler Zugriff auf die vorderen TrueDepth-Kameras der neuen iPhones oder das Weitwinkel- oder Teleobjektiv auf der Rückseite.

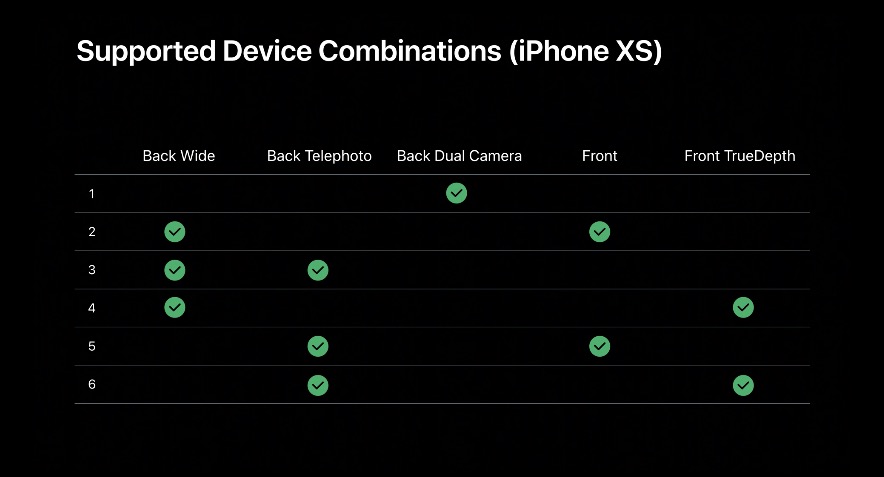

Dies bringt uns zu der Einschränkung, die die Funktion haben wird. Derzeit werden nur iPhone XS, XS Max, XR und das neue iPad Pro unterstützt. Keine anderen Geräte neu Funktion in iOS 13 Sie können es noch nicht verwenden und werden es wahrscheinlich auch nicht können.

Darüber hinaus hat Apple Listen mit unterstützten Kombinationen veröffentlicht. Bei näherer Betrachtung lässt sich feststellen, dass einige Einschränkungen weniger Hardware- als vielmehr Software-Charakter haben und Cupertino den Zugriff an einigen Stellen bewusst blockiert.

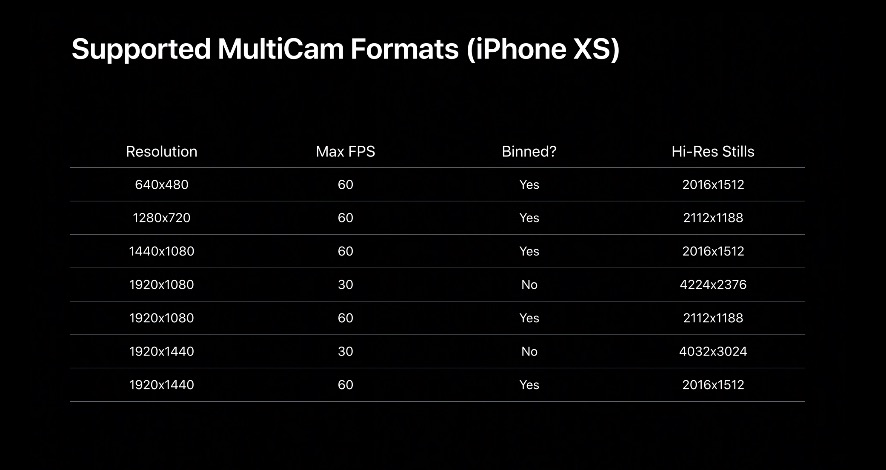

Aufgrund der Akkukapazität können iPhones und iPads nur einen Kanal für Multi-Kamera-Aufnahmen nutzen. Im Gegenteil, beim Mac gibt es keine solche Einschränkung, nicht einmal bei tragbaren MacBooks. Darüber hinaus wird die vorgestellte Funktion wahrscheinlich nicht einmal Teil der Kamera-App des Systems sein.

Die Fantasie eines Entwicklers

Die Hauptrolle wird daher das Können der Entwickler und ihre Vorstellungskraft spielen. Apple hat noch etwas gezeigt, und zwar die semantische Erkennung von Bildsegmenten. Unter diesem Begriff verbirgt sich nichts anderes als die Fähigkeit, eine Figur auf einem Bild, ihre Haut, Haare, Zähne und Augen zu erkennen. Dank dieser automatisch erkannten Bereiche können Entwickler dann verschiedene Teile des Codes und damit Funktionen zuweisen.

Es könnte sein interessiert dich

Auf dem Workshop WWDC 2019 wurde eine Anwendung vorgestellt, die den Hintergrund (Zirkus, Rückkamera) parallel zur Bewegung der Figur (Benutzer, Frontkamera) filmte und wie bei einem Clown mithilfe semantischer Regionen die Farbe der Haut einstellen konnte .

Wir können also nur gespannt sein, wie die Entwickler das neue Feature aufnehmen.

Source: 9to5Mac